La France a toujours été un terrain fertile pour l’open source, aussi bien dans les entreprises que dans le secteur public. Avec la problématique de plus en plus stratégique de la souveraineté, l’open source s’impose comme une arme de premier choix, qui trouve d’ailleurs un fort écho avec les modèles d’intelligence artificielle.

L’éditeur allemand Suse, très présent dans les serveurs exécutant des applications (comme SAP) et chez de nombreux hébergeurs et hyperscalers, retrouve depuis quelque temps une visibilité bien méritée.

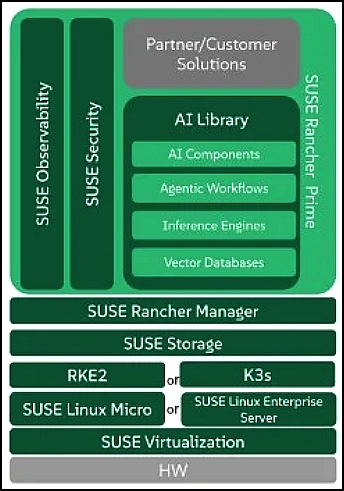

Outre des systèmes d’exploitation et du Cloud Hybride, Suse propose aussi un écosystème Kubernetes complet 100% open source couvrant tout: le système d’exploitation (ou celui d’un tiers), la gestion de cluster (K3s KE2), la sécurité intégrale (Neuvector), GitOps (Fleet), et jusqu’au stockage (Longhorn). L’éditeur a savamment enrichi et intégré ces deux acquisitions majeures: la plateforme complète de gestion Kubernetes Rancher (racheté en janvier 2020) et la solution complète 0de sécurité pour Kubernetes Neuvector (racheté en octobre 2021). Et, bien sûr, l‘annonce récente de SLES 16 (Suse Linux Enterprise Server) qualifié de “premier Linux d’entreprise à intégrer l’IA agentique”.

Qu’en est-il de l’IA, suite à l’annonce de SLE16? Comment se positionne-t-elle sur ces nouveaux enjeux? Comment entraine-t-elle son écosystème de partenaires pour répondre à une demande croissante d’innovation?… Afin de poser ces questions et quelques autres, Place de l’IT a rencontré Olivier Raffy, directeur général de Suse France. L’opportunité aussi de revenir sur la notion de “vrai open source”, de souveraineté, ou encore sur la place de la France chez cet éditeur européen.

Place de l’IT: Suse est présent chez les hébergeurs, les hyperscalers et dans des environnements critiques comme SAP. À l’heure du cloud hybride et de l’IA, quel est votre rôle?

Olivier Raffy: Avant tout, il faut rappeler qui nous sommes. Suse est une entreprise souveraine, européenne, allemande, et profondément open source.

Depuis 33 ans, notre ADN n’a pas changé. Historiquement, nous avons toujours accompagné les clients dans leurs workloads critiques. Et, plus récemment, dans la transition vers le cloud natif.

La réalité, c’est que le cloud est hybride.

Un grand nombre d’entreprises a tenté le “full public”, et ça n’a pas fonctionné. Ils reviennent vers leur patrimoine applicatif traditionnel, au moins en partie.

Donc, notre portfolio a évolué vers cette logique: accompagner l’hybridité, permettre de faire tourner Kubernetes n’importe où et de le manager de manière cohérente.

Concrètement, cela passe par Rancher ?

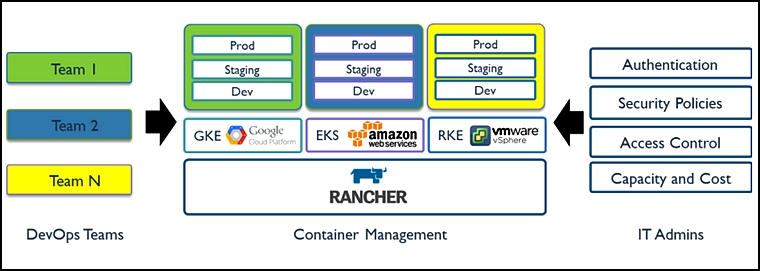

Exactement. Rancher apporte la gestion hybride et multicloud des environnements containerisés. Beaucoup d’organisations ont commencé la containerisation dans le cloud public parce que c’était plus simple, et détaché des équipes IT sur site (on-premise). Aujourd’hui, on retrouve Kubernetes partout: sur site, dans les usines, dans des environnements Edge (en bordure de réseau) et même dans l’embarqué. D’où la nécessité d’un point de pilotage central: Rancher.

Nous sommes totalement alignés avec les besoins de nos clients: hybridité, ouverture, absence de lock-in [dépendance vis-à-vis de l’éditeur], innovation.

Et surtout, un point important: le code est strictement le même entre Rancher communautaire et Rancher Prime (Enterprise). La différence, ce sont les services associés, jamais les fonctionnalités.

Qu’appelez-vous le “vrai open source”? Et, comment garantissez-vous l’absence de verrouillage?

Chez Suse, tout est disponible sur GitHub, récupérable, modifiable, forkable… Nous ne proposons pas de “freeware déguisé”. Les licences permettent la consommation, la modification, la redistribution.

Nous ne mettons aucun composant propriétaire essentiel qui enfermerait les clients. C’est ce que nous appelons “le vrai open source”.

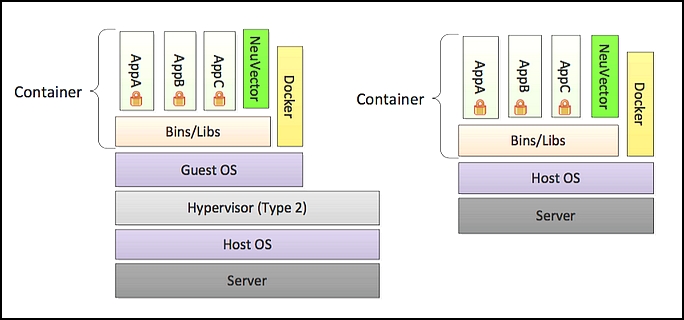

D’ailleurs, quand nous rachetons des solutions “closed source”, nous les “rouvrons” systématiquement: Neuvector pour la sécurité des containers de bout en bout devenue Suse Security (pare-feu, inspection réseau, scan des vulnérabilités, protection runtime, conformité, admission-control…) racheté en octobre 2021 et libéré en janvier 2022, StackState devenu Suse Observability. Ce n’est pas du marketing: c’est une philosophie technique et commerciale.

Le client a toujours le choix. Nous voulons qu’un client reste fidèle parce qu’il est satisfait, pas parce qu’il est enfermé.

Parlons IA. Beaucoup vous voient comme un acteur “infrastructure”. Alors, comment abordez-vous l’IA?

Pour nous, l’IA est un workload. Nous ne sommes pas des fondeurs et ne fabriquons pas de LLM. En revanche, nous fournissons une plateforme open source pour exécuter n’importe quel type de workload, y compris l’IA, qui tourne dans Kubernetes et consomme du GPU.

Notre valeur consiste à dire au client «Vous voulez faire tourner votre IA? Nous avons la stack [pile logicielle] pour la faire tourner, la sécuriser, l’observer.»

Aujourd’hui, beaucoup pensent IA=GPU. Toutefois, entre le GPU et l’application finale (chatbots, automatisation…), il y a aussi le middleware, la plateforme, la sécurité. Et c’est exactement là que nous intervenons.

Ainsi, lorsqu’un projet open source comme vLLM fournit une image conteneur, elle embarque souvent un OS avec des vulnérabilités. Eux se concentrent sur la couche applicative, pas sur la base système. Nous, nous récupérons ces images, nous les “rebuildons” en supprimant jusqu’à 90 % des CVE. Puis, nous signons, nous documentons, et nous en assurons la supply chain.

Et c’est précisément le sujet. Comment être sûr que le LLM ne véhicule pas des informations sensibles? Comment garantir que les conteneurs sont propres?

C’est là que nos capacités en sécurité, en observabilité et en Supply Chain s’appliquent.

Là encore, Suse n’impose pas son propre système d’exploitation. Nous fournissons une pile logicielle complète si le client le souhaite (OS, Rancher, gestion GPU…), mais il peut aussi venir “comme il est”: un autre OS Linux, un plugin réseau différent, son propre stockage…

Nous ne fermons jamais l’écosystème. Et nous savons même faire tourner du Kubernetes sur Windows avec Rancher/RKE2, une compétence très rare sur le marché.

Vous venez d’annoncer le premier OS d’entreprise intégrant l’IA agentique avec SLES 16…

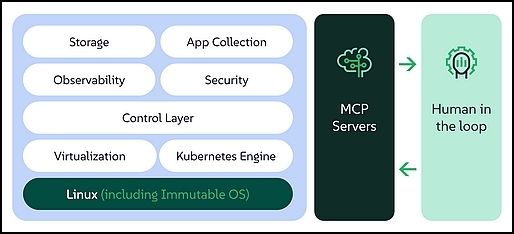

Avec SUSE Linux Enterprise Server 16 (SLES 16) [en preview], Suse place l’IA directement au cœur du système d’exploitation, en intégrant le tout premier agent IA natif. Ce dernier repose sur le Model Context Protocol (MCP), un standard ouvert qui permet aux entreprises d’adopter l’IA sans se retrouver enfermées dans un écosystème propriétaire.

Concrètement, SLES 16 fournit un cadre unique pour faire interagir agents et modèles d’IA, qu’ils soient internes, locaux ou hébergés dans le cloud, simplifiant ainsi l’intégration et l’exploitation de l’IA dans l’entreprise.

En parallèle, SLES 16 modernise l’administration avec Cockpit, une interface web intuitive (qui remplace YaST) destinée aux administrateurs pour gérer le système depuis une console moderne ou en ligne de commande, dans un environnement cohérent et simplifié.

Grâce à son architecture ouverte et évolutive, SLES 16 est le premier OS d’entreprise pensé pour l’IA agentique et les futurs workloads IA, tout en restant compatible avec de nombreux modèles et fournisseurs, offrant ainsi aux entreprises liberté, flexibilité et puissance pour innover.

Suivez-vous aussi les projets d’IA distribuée, LLMD et autres?

Absolument. Nous contribuons dans les communautés, mais toujours avec pragmatisme. Nous exigeons une réelle valeur ajoutée, un cadre de redistribution clair, et une maturité suffisante. Et, avant même d’intégrer un projet, nous étudions son licensing, car l’IA open source est souvent un “flou artistique”: ce qu’on peut redistribuer, ce qu’on peut utiliser, quand il faut payer une redevance… On travaille d’abord le juridique, puis l’intégration technique.

Vous évoquiez la supply chain logicielle. SUSE est-elle reconnue pour cela?

Depuis plus de 30 ans!

Notre façon d’assembler notre distribution Linux a même été reprise par d’autres acteurs. Aujourd’hui, nous appliquons les mêmes méthodes à Kubernetes.

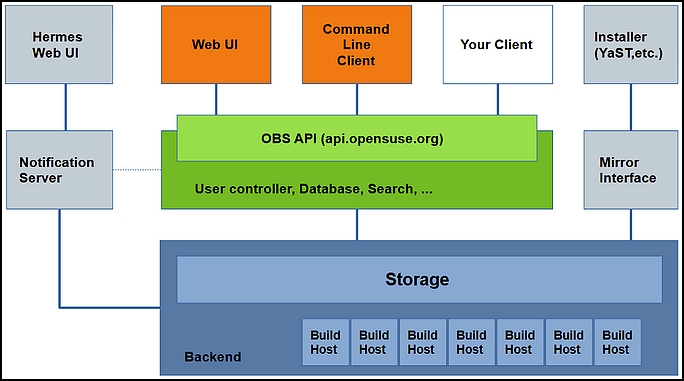

Par exemple, Open Build Service a été repris par la communauté Kubernetes comme modèle d’assemblage.

Et avec l’essor de l’IA, cette maîtrise est encore plus importante: les clients doivent savoir exactement ce qu’ils déploient.

Quid de vos partenaires en France? Sont-ils demandeurs de formation?

Oui, très clairement. Quand nous rachetons des solutions de sécurité, nous récupérons aussi les équipes et nous faisons monter nos propres ingénieurs en compétence.

Nous travaillons aussi énormément avec nos partenaires intégrateurs, MSP, revendeurs, etc. Ils fournissent des services, de la formation certifiante, du conseil, et nous construisons ensemble des offres communes.

Le Channel est essentiel dans notre modèle. Cet écosystème est vaste: revendeurs, GSI, MSP, cloud providers…

Ce qui change énormément depuis un an, c’est l’intérêt des grands intégrateurs. Avant, nous peinions à les convaincre, leurs habitudes les poussaient vers d’autres acteurs.

Aujourd’hui, avec les enjeux de souveraineté, l’extraterritorialité, les risques de verrouillage… ils viennent vers nous pour disposer d’une alternative européenne ouverte. C’est même devenu un axe stratégique.

Que représente la France pour SUSE au niveau mondial?

La France est l’un des trois pays “Tier-1” en Europe, avec l’Allemagne et le Royaume-Uni.

Nous réalisons les chiffres prévus, nous les dépassons même. Et ce qui nous distingue, c’est que la France est très en avance sur la modernisation des applications (containerisation, virtualisation, Kubernetes). En tout cas, plus que d’autres pays où le legacy pèse encore lourd.

Le marché est dynamique, innovant, et les attentes sont élevées.

Trop souvent, quand on évoque la France à l’étranger, on parle gastronomie, luxe, tourisme, grèves… Pourtant, la France est aussi une nation de chercheurs, de médailles scientifiques, et de contributions technologiques majeures.

Et les dirigeants américains que nous rencontrons le reconnaissent, parfois davantage que nos propres dirigeants.

Nous avons une responsabilité collective: rappeler que la France est un pays d’innovation, notamment dans le cloud, l’IA, et les technologies open source.